Modelo de IA inovador inspirado na dinâmica neural do cérebro.

Adam Conner-Simons | MIT CSAIL

Pesquisadores do Laboratório de Ciência da Computação e Inteligência Artificial do MIT desenvolveram um novo modelo de inteligência artificial inspirado nas oscilações neurais do cérebro, com o objetivo de aprimorar significativamente a forma como algoritmos de aprendizado de máquina lidam com sequências longas de dados.

A IA frequentemente enfrenta dificuldades para analisar informações complexas que se desenvolvem ao longo do tempo, como tendências climáticas, sinais biológicos ou dados financeiros. Um novo tipo de modelo de IA, chamado de “modelo de espaço de estados” (state-space models), foi projetado especificamente para entender esses padrões sequenciais com mais eficácia. No entanto, os modelos existentes frequentemente enfrentam desafios — podem se tornar instáveis ou exigir muitos recursos computacionais ao processar sequências extensas de dados.

Para resolver esses problemas, os pesquisadores do CSAIL, T. Konstantin Rusch e Daniela Rus, desenvolveram o que chamam de “modelos lineares oscilatórios de espaço de estados” (LinOSS), que utilizam princípios de osciladores harmônicos forçados — um conceito profundamente enraizado na física e observado em redes neurais biológicas. Essa abordagem oferece previsões estáveis, expressivas e computacionalmente eficientes, sem impor condições excessivamente restritivas aos parâmetros do modelo.

“Nosso objetivo era capturar a estabilidade e a eficiência observadas em sistemas neurais biológicos e traduzir esses princípios para uma estrutura de aprendizado de máquina”, explica Rusch. “Com o LinOSS, agora conseguimos aprender interações de longo alcance de forma confiável, mesmo em sequências com centenas de milhares de pontos de dados ou mais.”

O modelo LinOSS é único ao garantir previsões estáveis com muito menos restrições de design do que métodos anteriores. Além disso, os pesquisadores comprovaram rigorosamente a capacidade de aproximação universal do modelo, o que significa que ele pode aproximar qualquer função contínua e causal que relacione sequências de entrada e saída.

Testes empíricos demonstraram que o LinOSS superou consistentemente os modelos mais avançados em diversas tarefas exigentes de classificação e previsão de sequências. Notavelmente, o LinOSS teve desempenho quase duas vezes superior ao do amplamente utilizado modelo Mamba em tarefas que envolvem sequências extremamente longas.

Reconhecida por sua relevância, a pesquisa foi selecionada para apresentação oral na ICLR 2025 — uma honra concedida apenas ao 1% superior das submissões. Os pesquisadores do MIT acreditam que o modelo LinOSS pode ter um impacto significativo em áreas que se beneficiariam de classificações e previsões precisas de longo prazo, como análise de dados na saúde, ciência climática, direção autônoma e previsão financeira.

“Este trabalho exemplifica como o rigor matemático pode levar a avanços de desempenho e aplicações amplas”, afirma Rus. “Com o LinOSS, estamos oferecendo à comunidade científica uma ferramenta poderosa para entender e prever sistemas complexos, fazendo a ponte entre a inspiração biológica e a inovação computacional.”

A equipe acredita que o surgimento de um novo paradigma como o LinOSS será de grande interesse para os profissionais de aprendizado de máquina desenvolverem novas aplicações. Para o futuro, os pesquisadores planejam aplicar seu modelo a uma gama ainda mais ampla de modalidades de dados. Além disso, sugerem que o LinOSS pode oferecer insights valiosos à neurociência, aprofundando potencialmente nossa compreensão sobre o próprio cérebro.

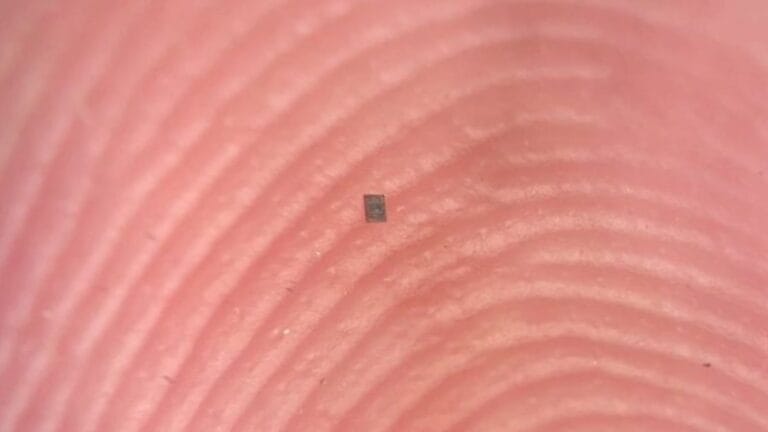

- Veja também: O menor marcapasso do mundo

O trabalho contou com apoio da Fundação Nacional de Ciência da Suíça, do programa Schmidt AI2050 e do Acelerador de Inteligência Artificial da Força Aérea dos Estados Unidos.

Republicado com permissão do MIT News.